Entre l’affaire Cambridge Analytica, les tentatives d’ingérence dans les élections françaises et les opérations d’influence en Ukraine, les méthodes visant à influencer les populations sont maintenant perçues comme une réalité par les opinions publiques occidentales. Or, un nouveau phénomène émerge depuis quelques années avec le développement de l’intelligence artificielle (IA) et ses potentialités de création et d’apprentissage : les deepfakes, ou hypertrucages en français. Quelle est la nature de ces contenus de synthèse ? Comment leur utilisation pourrait influencer les opinions publiques ?

Qu’est-ce qu’un deepfake ?

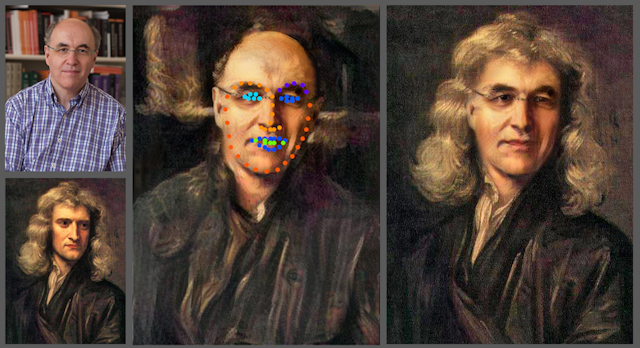

Les hypertrucages sont des matériaux de synthèse, qui « truquent » avec beaucoup de réalisme des vidéos ou fichiers audio. On parle de deepfakes car ces contenus sont créés avec la technologie d’apprentissage profond (deep learning), qui applique la simulation de réseaux neuronaux à des ensembles de données massives, ici pour créer un faux réaliste. Grâce à ses capacités d’apprentissage, l’IA reconnaît et apprend ce à quoi ressemble un « visage source » sous différents angles, puis le transpose sur une cible (souvent un acteur pornographique). Le visage source apparaît comme un masque au rendu très réaliste. Ces hypertrucages sont aujourd’hui connus notamment grâce à contrefaçons impliquant des acteurs célèbres comme Nicolas Cage. Le niveau de réalisme est tel que le public prendra facilement la fausse vidéo pour la réalité.

Ce réalisme est à l’origine d’une vidéo d’alerte réalisée par Jordan Peele en 2018. Dans ce film, on voit Barack Obama insulter le président Trump… alors que ce sont en fait les propos de Peele plaqués sur le visage d’Obama. Cette vidéo à visée pédagogique se conclut par une mise en garde suggérant de rester alertes devant les contenus que l’on visionne. Elle reflète la crainte qu’inspirent ces supports quant à leur capacité d’influencer des opinions publiques qui ne seraient pas en mesure de discerner la supercherie, impactant ainsi potentiellement les équilibres internes des États ou les équilibres géopolitiques, notamment dans des contextes de tension.

Des gendarmes et des voleurs pour générer des deepfakes

La technique de fabrication de deepfake la plus populaire est celle des generative adversarial network. Leur fonctionnement repose sur la mise en concurrence de deux réseaux neuronaux sur le modèle du gendarme et du voleur. Alors que le réseau « générateur » (le voleur) produit des contenus artificiels, le « discriminateur » (le gendarme) le compare avec le matériel d’origine afin de trier les vraies images et celles modifiées. En s’appuyant sur ces résultats, le générateur affine sa méthode et crée un nouvel hypertrucage plus difficile à discerner, et ainsi de suite jusqu’à ce que la discrimination soit impossible. Ce niveau de réalisme fait dire à la MIT Technology Review que les deepfakes sont une arme parfaite pour ceux qui voudraient influencer les marchés financiers ou le résultat d’élections. L’apparition de diverses applications permettant de créer de fausses vidéos pourrait facilement permettre à un large public de les exploiter dans des buts différents.

Le sujet est pris très sérieux à la veille des élections présidentielles américaines. À ce titre, le Media Forensics de la Defense Advanced Research Projects Agency (DARPA) a été financé à échelle 28 millions de dollars jusqu’en 2020 pour mener des travaux de détection des deepfakes. Quatre techniques sont étudiées : la synchronisation labiale, la détection d’incohérence sonore et de l’espace de la vidéo (taille de la pièce, acoustique) ; l’identification des chutes de cadre et l’insertion de contenu. Facebook, Microsoft et d’autres acteurs privés étudient aussi le sujet. Aujourd’hui, plusieurs structures annoncent pouvoir détecter de 95 à 97 % des deepfakes. Les 3 à 5 % restant représentent néanmoins un grand nombre d’images potentiellement fausses, quand on sait que Facebook reçoit environ 350 millions d’images par jour et que 8 millions de vidéos y sont consultés quotidiennement. Aussi il semble pertinent de comprendre ce qui poussera un spectateur à croire un contenu proposé.

On croit mieux ce que l’on croit… déjà

Les facteurs psychologiques qui favorisent la croyance dans le contenu proposé sont aussi importants que l’authenticité apparente du deepfake présenté. En effet, il est toujours plus facile, tentant, de croire ce qui convient à nos aspirations, croyances et valeurs. Par exemple, peu après l’investiture de Donald Trump, son attaché de presse déclarait que la cérémonie avait réuni plus de spectateurs qu’aucune autre. La vérité était facilement observable en comparant deux photographies. Malgré cela, de nombreux partisans du président Trump continuaient de dire que cette inauguration réunissait plus de monde car ils s’étaient persuadés de l’importance de la foule malgré les éléments objectifs.

Ainsi, si une information met en avant des éléments contredisant les croyances préexistantes d’un individu, il aura tendance à contorsionner les faits pour les aligner sur ses croyances ou à les rejeter immédiatement. Dans ce contexte, un contenu ciblant les facteurs émotionnels ou les valeurs d’un individu sera plus crédible, et cela quasi indépendamment de la qualité du support présenté. En outre, la simple visualisation d’un contenu peut participer à renforcer la croyance du spectateur quand bien même ce dernier saurait qu’il ne s’agit pas d’un support empreint de vérité.

Un autre facteur déterminant la confiance donnée a un contenu est lié à la personne transmettant l’information : 51 % des personnes sondées affirment croire en l’information délivrée par l’entremise d’une connaissance contre 34 % dans le cas où le contenu n’aurait pas été transmis par une personne connue. Connaître le transmetteur de l’information abaisse le seuil de vigilance, limitant notamment la vérification des sources, un des premiers pas pour débusquer les fausses nouvelles. Selon cette même étude, la même tendance se retrouve dans la diffusion du message, s’il vient d’une personne connu 34 % des sondés le retransmettront contre 24 % dans le cas contraire. On peut supposer que la tendance à repartager un contenu accroîtra avec le réalisme du contenu proposé. Or la crédibilité de tout faux augmente avec sa popularité, avec le nombre de personnes à l’avoir lu, vu et partagé : avec sa viralité.

La viralité sur les réseaux, un facteur déterminant ?

Le modèle des réseaux sociaux interdit le contrôle institutionnel de la véracité de contenus pouvant devenir viraux, ce qui renforce la crainte que les fausses vidéos deviennent des outils d’influence. Or, si les réseaux sociaux ont explosé, plusieurs points laissent penser que les deepfakes ne seront pas une révolution si massive. Le premier est en lien direct avec un des effets pervers des réseaux : l’effet bulle. En choisissant leurs centres d’intérêt, les internautes donnent des informations personnelles rendant ainsi possible la création d’un profil, ce qui permet aux algorithmes de proposer prioritairement des contenus adaptés aux préférences du « client », majoritairement des éléments confirmatoires. Ceci crée une sorte d’enfermement. Cet effet d’enfermement pourrait limiter la viralité permettant à un hypertrucage de devenir un acteur d’influence idéologique de premier plan.

En pratique, une large part de l’auditoire touché par le deepfake serait alors déjà convaincue du message véhiculé, ce qui renforcerait des croyances mais ne créerait pas de basculement idéologique. Grâce aux effets bulles, les fausses vidéos seraient cantonnées à un auditoire restreint, souvent déjà conquis par l’idée véhiculée. Néanmoins, ces effets bulles pourraient être outrepassés par le développement de divers deepfakes servant la même finalité mais visant diverses valeurs et croyances, donc différents profils sociologiques, touchant ainsi plusieurs strates de population qui partageraient l’hypertrucage dans leurs propres cercles et en accroîtraient ainsi à la viralité.

Le nombre de fausses vidéos augmente, et il pourrait devenir fréquent pour un internaute d’en visualiser alors que leur détection resterait problématique. L’influence des deepfakes résiderait donc aussi dans l’incapacité des individus à les discriminer de la réalité, les poussant à tout croire ou, par réaction, à ne plus rien croire – ce qui serait également dommageable pur la société civile.

Cependant, certains points peuvent modérer l’angoisse engendrée par l’essor des deepfakes. Tout d’abord leur apparente authenticité n’est pas le seul facteur de croyance. Les fausses vidéos s’approchent en cela des faux plus classiques et il est possible qu’il y ait une adaptation sociétale, comme lors de l’apparition de la photographie où de nombreux montages pullulèrent. Quand la technologie était encore peu connue, les clichés étaient considérés comme une preuve absolue. Cependant, avec le temps, la société a appris à prendre une certaine distance face à ce média. Enfin, si la fréquence des hypertrucages augmente dans la sphère politique, 96 % d’entre eux restent des contenus pornographiques.

Quelles que soient les évolutions à venir, les deepfakes constituent une arme supplémentaire dans l’arsenal des outils mobilisables lors de campagnes d’influence. Leur apparente authenticité et leur potentielle viralité doivent être prises en compte car le public sera de plus en plus confrontés à ce type de contenus.