Il y a quelques années, le Wall Street Journal (2011) publiait un article sur les « petits secrets » de la recherche médicale indiquant que la plupart des résultats issus des études publiées dans des revues scientifiques ne pouvaient être reproduits. John Ioannidis (2005), professeur à Stanford, a ainsi montré que les bases statistiques sur lesquelles s’appuyaient bon nombre d’études médicales n’étaient pas suffisamment rigoureuses pour que les résultats obtenus aient une véritable valeur.

Depuis quelques années, c’est au tour des recherches en économie d’être pointées du doigt. Une étude récente de John Ioannidis, T.D. Stanley et Hristos Doucouliagos (2016), à paraître dans l’Economic Journal, montre ainsi que plus de 80 % des études économétriques exagèrent l’ampleur et la significativité statistique des résultats obtenus. Selon eux, les études publiées en économie sont aussi biaisées que celles publiées en sciences médicales. Comment peut-on expliquer le manque de fiabilité de certaines recherches publiées dans les revues scientifiques ?

« Les revues scientifiques ont tendance à ne retenir qu’un certain type d’études »

En fait, plusieurs études ont montré qu’il existait un biais inhérent au processus de publication dans les revues académiques et ce quel que soit le domaine de recherche. En effet, la plupart des revues scientifiques ont tendance à ne retenir à la publication qu’un certain type d’études, celles dont les résultats sont statistiquement significatifs ou celles dont les résultats sont positifs, notamment en médecine où ce type de biais est très fréquent.

Charles Wheelan (2013) fournit une excellente illustration de ce biais en médecine. Supposons qu’une équipe de chercheurs décide de mener une étude longitudinale rigoureuse examinant le lien entre le fait de jouer aux jeux vidéo et le cancer du côlon. À partir d’un échantillon représentatif de 100 000 individus suivis pendant 20 ans, les chercheurs constatent que les personnes qui ont passé plus de 3 heures par jour en moyenne à jouer aux jeux vidéo déclarent le même nombre de cancers du côlon que ceux qui n’ont jamais joué. On suppose que l’approche méthodologique est irréprochable.

Quelle revue académique acceptera de publier une telle étude ? Aucune et pour deux raisons. Tout d’abord, il n’y a aucune raison scientifique de penser que le fait de jouer aux jeux vidéo puisse avoir un lien avec le cancer du côlon. Ensuite, le fait qu’un facteur ne soigne pas le cancer n’est pas un résultat jugé intéressant. Après tout, beaucoup d’autres facteurs ne préviennent pas le cancer. En définitive, les résultats négatifs ne sont pas passionnants en médecine comme dans n’importe quel autre champ de recherche et il y a peu de chances que de tels résultats soient publiés dans une revue médicale.

Supposons maintenant qu’un autre chercheur mène une étude longitudinale différente sur le même sujet. Il observe que les personnes qui passent leur temps à jouer aux jeux vidéo sont moins souvent atteints d’un cancer du côlon. Cette fois, cela devient vraiment intéressant. C’est exactement le type de découverte qui va susciter l’intérêt d’une revue académique puis de la presse grand public… jusqu’aux fabricants de jeux vidéo eux-mêmes – qui pourraient aller jusqu’à apposer un label sur leurs produits indiquant les bienfaits des jeux vidéo pour la santé !

« Le hasard est partout »

Pourtant, c’est oublier un peu vite que, statistiquement, des événements rares surviennent de temps à autre simplement par hasard. Si vous menez une centaine d’études, au moins une d’entre elles obtiendra, fort probablement, des résultats qui n’auront aucun sens – comme une association entre le fait de jouer aux jeux vidéo et une propension plus faible d’être atteint d’un cancer du côlon.

Voilà donc le problème : les 99 autres études qui n’observent aucune relation ne seront pas publiées parce qu’elles ne sont tout simplement pas jugées intéressantes. En revanche, l’unique étude qui obtiendra un lien statistique sera publiée et fera même l’objet d’une attention particulière. L’origine de ce biais ne vient donc pas des études elles-mêmes mais de la sélection des informations qui sont diffusées au public. Quelqu’un qui consulterait la littérature scientifique sur le lien entre les jeux vidéo et le cancer n’aurait connaissance que d’une seule étude et celle-ci suggérait un lien étroit entre le fait de jouer aux jeux vidéo et le risque d’être atteint d’un cancer. En réalité, 99 % des études existantes n’auraient rien démontré de tel.

« Le biais de publication pose un sérieux problème »

Cet exemple de Charles Wheelan est délibérément absurde mais le problème est réel et sérieux. Il y a quelques années le New York Time (2008) évoquait le problème du biais de publication de la façon suivante :

« Les fabricants d’antidépresseurs comme le Prozac et le Paxil ne publient pas les résultats d’un tiers des essais cliniques qu’ils conduisent afin d’obtenir l’agrément des gouvernements, trompant les médecins et les malades sur l’efficacité de ces médicaments. »

Il s’avère que 94 % des études présentant des résultats positifs ont fait l’objet de publication contre seulement 14 % des études présentant des résultats négatifs ou neutres. Finalement, lorsque toutes les études sont prises en compte, les antidépresseurs sont à peine plus efficaces que les placebos.

Si les revues scientifiques sont plus sensibles aux résultats positifs et ignorent les résultats non significatifs alors les chercheurs auront tendance à ne publier que l’étude suggérant un lien significatif et à ignorer celles qui n’observent aucun effet.

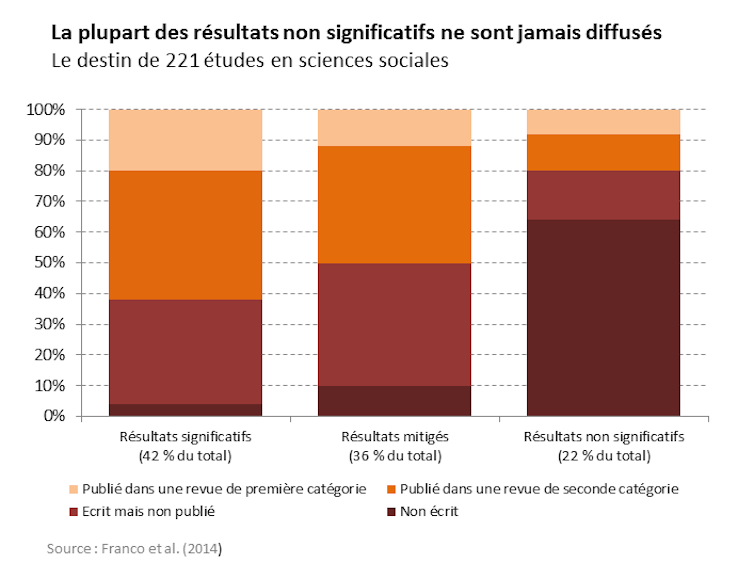

Ainsi, presque 80 % des études présentant des résultats non significatifs en sciences sociales ne sont pas publiées contre seulement 38 % des études présentant des résultats significatifs (Figure 1).

*Figure 1. Taux de publication de 221 études en sciences sociales selon la nature des résultats obtenus *

Or, ces dernières s’appuient souvent sur de petits échantillons au sein desquels les risques de fluctuations aléatoires sont plus élevés (les statisticiens parlent de fluctuations d’échantillonnage et disent que l’étude manque de puissance statistique conduisant finalement à donner plus de poids à des études qui ne le méritent pas.

À cela s’ajoute le fait que les chercheurs peuvent ne pas être impartiaux et peuvent avoir des croyances fortes qu’ils cherchent à valider et à diffuser sous couvert d’apparence scientifique (Fanelli, 2009).

« La moitié des articles publiés en économie se révèle incorrecte »

Pour toutes ces raisons, un niveau étonnant de recherches d’économistes se révèle complétement erroné et difficile à répliquer. John Ioannidis, T.D. Stanley et Hristos Doucouliagos (2016) ont examiné 159 études publiées dans les principales revues d’économie.

Les auteurs estiment qu’environ la moitié des articles scientifiques publiés se révèle incorrecte parce qu’ils manquent de puissance statistique, s’appuient sur des outils économétriques inadaptés, sont l’objet de biais et parfois même de malhonnêteté intellectuelle. John Ioannidis et Hristos Doucouliagos (2013) ont aussi montré que 88 % des études économiques obtenaient des résultats conformes aux hypothèses formulées par leurs auteurs, un taux cinq fois supérieur à celui des recherches de la NASA par exemple (Fanelli, 2010). Au final, Miguel et Christensen (2017) indiquent qu’un tiers des recherches en économie a été réfuté par d’autres travaux ultérieurement.

« Pour une plus grande transparence et une meilleure valorisation de l’évaluation par les pairs »

Face à ce constat, John Ioannidis, qui co-dirige le Metrics (Meta-Research Innovation Center at Stanford), propose plusieurs actions afin que les résultats des études scientifiques soient plus robustes. Il suggère tout d’abord une plus grande collaboration entre les chercheurs et l’utilisation de la méta-analyse afin de travailler sur de plus grands échantillons permettant de limiter le risque d’erreur de seconde espèce (accepter un résultat alors qu’il est faux).

Il recommande ensuite de multiplier les réplications d’études pour s’assurer que les effets obtenus ne sont pas erronés ou falsifiés. Enfin, il considère que le système scientifique actuel doit évoluer de telle sorte que la publication ne doit pas être le seul critère de progression de carrière des chercheurs. Il propose par exemple de valoriser le travail de révision d’articles par les pairs qui, selon lui, n’est pas suffisamment pris en compte dans la carrière des chercheurs.

Ces dernières années ont été marquées par plusieurs scandales dans le monde de la recherche. Quelques chercheurs très prolifiques se sont avérés être des producteurs d’études médiocres, non reproductibles, erronées ou parfois même complètement fabriquées dans le seul but de bénéficier d’avancements de carrières ou de primes.

Miguel et Christensen (2017) constatent néanmoins que les meilleures revues scientifiques en économie sont beaucoup plus vigilantes aujourd’hui. Elles demandent notamment aux auteurs de fournir leurs données et de bien préciser les liens et conflits d’intérêt éventuels des auteurs.

Voilà qui tranche avec les pratiques antérieures et constitue un progrès indispensable pour rendre toutes ses lettres de noblesse à la recherche économique.